La arquitectura Blackwell de NVIDIA se presento en GTC 2024 y los primeros sistemas comerciales empezaron a llegar a hiperescalares seleccionados a finales de 2024. En septiembre de 2025 ya hay suficientes despliegues reales, suficientes mediciones publicas y suficiente experiencia operativa para valorar que cambia en la practica del entrenamiento de modelos grandes. Este repaso se centra en GB200 NVL72, que es donde Blackwell se expresa con toda su logica, y no en las B200 sueltas o en variantes como la B100.

La idea central: el rack como unidad

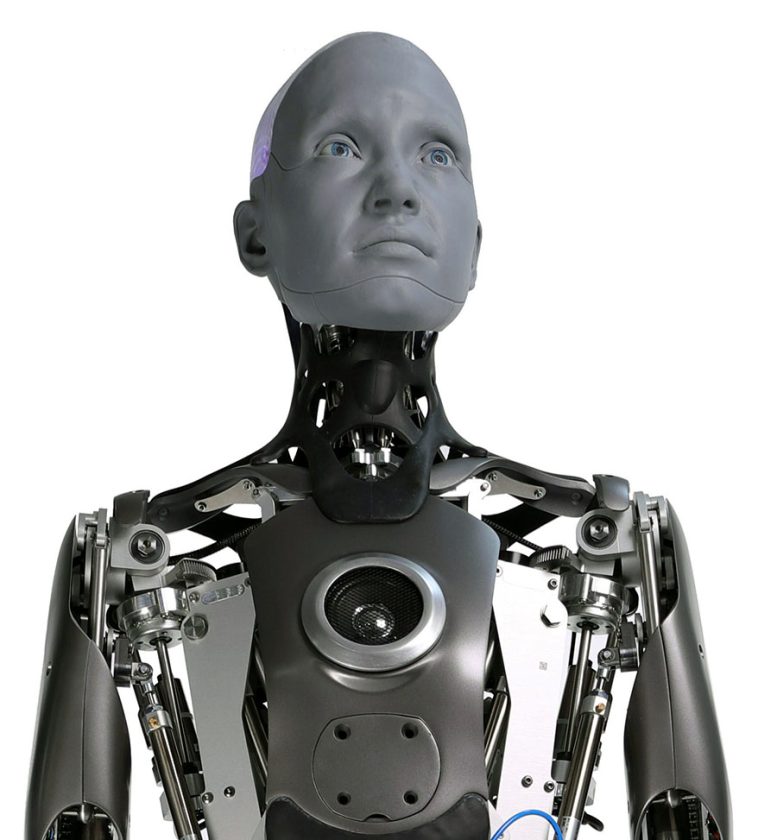

Lo mas distintivo de Blackwell no es la GPU en si, aunque el salto respecto a Hopper es sustancial. Lo distintivo es que NVIDIA ha dejado de disenar GPUs y ha empezado a disenar racks. El GB200 NVL72 integra 72 GPUs Blackwell y 36 CPUs Grace en un solo armario de aproximadamente 120 kilovatios, conectadas entre si por NVLink de quinta generacion a 1.8 terabytes por segundo. Para el software el rack se comporta como una unica maquina de memoria unificada con 13.5 terabytes de HBM3e.

Esto es un cambio conceptual importante. Con Hopper y las generaciones anteriores, el paralelismo de modelo requeria particionar el modelo entre GPUs y gestionar explicitamente la comunicacion entre ellas mediante NCCL. Con GB200 NVL72, 72 GPUs pueden acceder a la memoria de las demas como si fuera local, aunque con latencia mayor. Esto simplifica patrones de entrenamiento donde la comunicacion entre particiones es intensa, como el paralelismo tensorial o los modelos con mezcla de expertos.

Que mide la industria en rendimiento real

Los numeros sinteticos de NVIDIA apuntan a 4 veces mas rendimiento de entrenamiento que H100 con la misma precision, y hasta 30 veces mas en inferencia con precisiones mixtas FP4. En la practica los primeros clientes reportan mejoras mas moderadas pero aun significativas. Meta y Microsoft han publicado resultados en MLPerf Training v5.0 durante el verano de 2025 donde GB200 NVL72 entrena Llama 3 70B entre 2.2 y 2.8 veces mas rapido que el equivalente en H100, por GPU y con el mismo presupuesto de potencia.

La diferencia entre el 4x teorico y el 2.5x real es interesante. Una parte viene de que los benchmarks sinteticos suelen asumir precision FP8 o FP4, mientras que los entrenamientos reales todavia usan bastante BF16 por razones de estabilidad. Otra parte viene de que el software de NVIDIA para Blackwell, en particular cuDNN 9 y las ultimas versiones de TransformerEngine, todavia esta madurando. Se espera que las siguientes versiones cierren la brecha hasta 3x o mas.

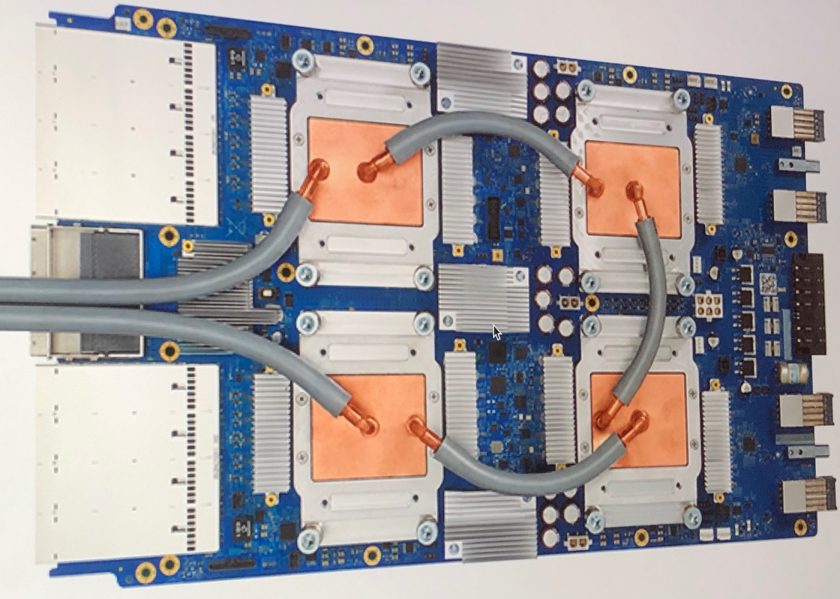

El otro numero relevante es el consumo. Una GPU Blackwell B200 consume 1000 vatios, frente a los 700 de H100. Un rack completo GB200 NVL72 esta en 120 kilovatios, aproximadamente 10 veces lo que consume un rack tradicional de servidores de proposito general. Esto obliga a refrigeracion liquida directa en el chip, algo que en 2023 era minoritario y que en 2025 se ha convertido en el requisito por defecto para centros de datos de IA.

El papel de FP4 y la cuantizacion

Una de las novedades tecnicas de Blackwell es el soporte nativo para FP4, una precision de 4 bits por elemento que no existia en Hopper. FP4 no es util para entrenamiento, donde los gradientes requieren mas precision para converger, pero es muy util para inferencia de modelos grandes. Un modelo entrenado en BF16 y cuantizado a FP4 cabe en un cuarto del espacio, consume un cuarto del ancho de banda de memoria, y se ejecuta mucho mas rapido si el hardware lo soporta nativamente.

El problema de FP4 es que no todos los modelos se cuantizan bien a 4 bits. Para transformers densos grandes, tipo Llama o Mistral, FP4 con calibracion cuidadosa pierde entre 0.5 y 2 puntos en benchmarks estandar. Para modelos con mezcla de expertos o para tareas sensibles a precision numerica, la caida es mayor. La recomendacion actual es usar FP8 para inferencia de alta calidad y FP4 para casos donde el coste importa mas que los ultimos puntos de calidad.

Esto tiene una implicacion practica: Blackwell es mas atractivo para quien tiene cargas de inferencia masivas que para quien solo entrena. Un centro de datos dedicado a servir millones de consultas por segundo a modelos grandes obtiene mas beneficio de FP4 que uno dedicado a entrenar un modelo nuevo cada dos meses. Los hiperescalares tienen las dos cargas y pueden amortizar el hardware en ambas; los centros academicos o las startups tienden a inclinarse mas hacia el entrenamiento.

Software: el ecosistema sigue evolucionando

El ecosistema de software para Blackwell tiene dos niveles. En el nivel bajo, CUDA 12.5 y cuDNN 9 ya incluyen el soporte estable, lo mismo que NCCL 2.22. En el nivel alto, los entornos mas populares van detras. PyTorch 2.5, publicado en octubre de 2024, anadio soporte inicial de Blackwell, pero las primeras optimizaciones reales llegaron en 2.6 en enero de 2025. JAX ha seguido una trayectoria similar con soporte experimental en 0.4.35 y estable en 0.5.

La consecuencia practica es que si decidiste comprar o alquilar Blackwell en el primer trimestre de 2025, te tocaba pelear con software inmaduro. En septiembre de 2025 el ecosistema esta maduro para entrenamiento de modelos estandar, pero sigue habiendo casos de borde. Entrenamientos con mezcla de expertos muy grandes, ciertos patrones de paralelismo por etapas, o nucleos personalizados compilados con Triton, todavia pueden dar problemas de rendimiento o correctitud. Los equipos serios mantienen un entorno Hopper paralelo para verificar.

Precio, disponibilidad y alternativas

En septiembre de 2025 un rack GB200 NVL72 cuesta alrededor de 3 millones de dolares para un comprador directo, y los plazos de entrega rondan los 9 meses salvo para los grandes clientes preferenciales. Esto implica que durante 2025 y buena parte de 2026, el acceso a Blackwell es basicamente a traves de la nube: CoreWeave, Lambda, Crusoe, Azure, AWS y Google Cloud tienen instancias disponibles a precios que van desde 6 a 12 dolares por GPU-hora segun region y compromiso.

Las alternativas reales son pocas. AMD Instinct MI300X ha ganado cuota en 2025 con buen rendimiento y mejor ratio memoria-por-dolar, pero el ecosistema de software ROCm sigue por detras del CUDA y los equipos serios lo tratan como segunda opcion. Las aceleradoras de Google TPU v5p siguen siendo competitivas pero solo disponibles dentro de Google Cloud. Intel Gaudi 3 ha quedado relegada a un tercer escalon.

Cuando compensa

Para la mayor parte de empresas que entrenan modelos propios, Blackwell solo tiene sentido si el coste del tiempo de entrenamiento es el cuello de botella dominante. Si una iteracion de entrenamiento tarda una semana en H100 y dos dias en Blackwell, la ganancia puede justificar el coste extra. Si la iteracion tarda tres dias en H100 y uno en Blackwell, el calculo es menos claro porque el tiempo humano en preparar datos y analizar resultados suele ser mas largo que el propio entrenamiento.

Para inferencia, el calculo depende del volumen. A volumenes bajos, Hopper sigue siendo mas eficiente en coste por consulta, porque Blackwell esta sobredimensionada. A volumenes altos, sobre todo con cuantizacion FP4, Blackwell puede reducir el coste por consulta en un factor de 3 a 5. El punto de cruce esta entre el 10% y el 30% de utilizacion sostenida segun el tipo de modelo.

Mi lectura

Blackwell marca un cambio de fase en la infraestructura de IA que es importante entender aunque no vayas a tocar uno de estos racks directamente. Cuando NVIDIA disenia el producto como rack y no como GPU, esta empujando a la industria a un modelo donde la unidad de compra y la unidad operativa son el armario completo, con refrigeracion liquida y 120 kilovatios de densidad. Esto cambia los requisitos de los centros de datos, el perfil de los equipos de operaciones, y las decisiones de co-diseno entre hardware y software.

Para quien construye aplicaciones de IA, la parte relevante es que los modelos mas grandes van a estar disponibles mas rapido y mas baratos via API. El coste de entrenar un modelo de frontera sigue creciendo, pero el coste unitario de consulta esta bajando. Esto favorece estrategias que consumen modelos de terceros mediante API frente a estrategias que entrenan modelos propios. Solo los casos donde el modelo en si es la diferencia competitiva, o donde los datos no pueden salir de la organizacion, justifican entrenar.

Para quien opera infraestructura tradicional, Blackwell es una invitacion a pensar en que parte de la pila de centros de datos pertenece todavia al futuro de proposito general y cual pertenece al futuro de cargas especializadas de IA. La respuesta probablemente sea que durante los proximos cinco anios los centros de datos se dividen en dos tipos con perfiles radicalmente distintos, y mezclarlos en un mismo edificio deja de tener sentido.