Lecciones de agentes en producción en 2025: resumen para 2026

Actualizado: 2026-05-03

El año 2025 fue el primero en que los agentes IA dejaron de ser proyecto piloto para convertirse en sistema productivo en cientos de empresas. Al entrar en 2026 hay datos suficientes para extraer lecciones que en 2024 eran todavía especulación. Este artículo ordena los aprendizajes que aparecen de forma recurrente en postmortems públicos, conversaciones con equipos y análisis compartidos por plataformas como Anthropic, OpenAI y LangChain.

Puntos clave

- Tres modos de fallo dominan: bucle de razonamiento degenerativo, alucinación de datos en sistemas RAG, y desalineamiento silencioso entre lo pedido y lo interpretado.

- El coste por tarea resuelta queda entre 0,05 y 0,30 dólares en la mayoría de casos productivos.

- Los equipos con éxito medible comparten un patrón de evaluación continua con dataset de 50 a 500 casos reales.

- Tres características hacen que una tarea sea mala candidata: consecuencia alta de error pequeño, contexto no documentado, y coste de verificación mayor que el coste de hacer la tarea.

Los modos de fallo más frecuentes

Tres tipos de fallo aparecen en la mayoría de los postmortems con diferencia sobre el resto.

El bucle de razonamiento degenerativo: el agente entra en un ciclo donde cada paso consume tokens pero no avanza hacia el objetivo. A veces llega por error de la herramienta que devuelve resultado ambiguo, a veces por prompt mal diseñado que no establece criterio claro de terminación. El coste económico puede ser alto (casos documentados de un solo bucle consumiendo más de mil llamadas al modelo en pocos minutos).

La defensa que ha mostrado mejor resultado es doble:

- Límite duro de pasos por tarea (habitualmente entre 15 y 30 según complejidad).

- Criterio explícito de terminación que el agente debe verificar en cada paso.

Cuando alguna de esas dos barreras falta, los bucles aparecen antes o después.

La alucinación de datos en sistemas que combinan recuperación con generación: el agente busca información en documentos internos, recibe fragmentos parciales y rellena huecos con datos plausibles pero inventados. En sectores regulados esto ha generado incidentes reportables.

La mitigación que funciona es exigir citas explícitas donde el agente referencie la fuente exacta de cada dato relevante y separar claramente el contenido recuperado del generado. Los equipos que han aplicado este patrón con disciplina reportan reducciones del orden del 90% en incidentes de alucinación sobre datos corporativos. Para el detalle de cómo implementar esta evaluación, ver evaluaciones de agentes en producción.

El desalineamiento silencioso entre lo que el usuario pide y lo que el agente entiende: en tareas complejas, el agente completa lo que interpretó pero el usuario pedía otra cosa. Sin punto de verificación intermedia, el error se descubre al final y el coste de rehacer es alto.

La solución son puntos de confirmación explícita en tareas largas: el agente presenta su interpretación del objetivo y el plan antes de empezar, el usuario aprueba o corrige, y solo entonces ejecuta. Añade fricción pero el saldo neto es favorable en casi todos los contextos.

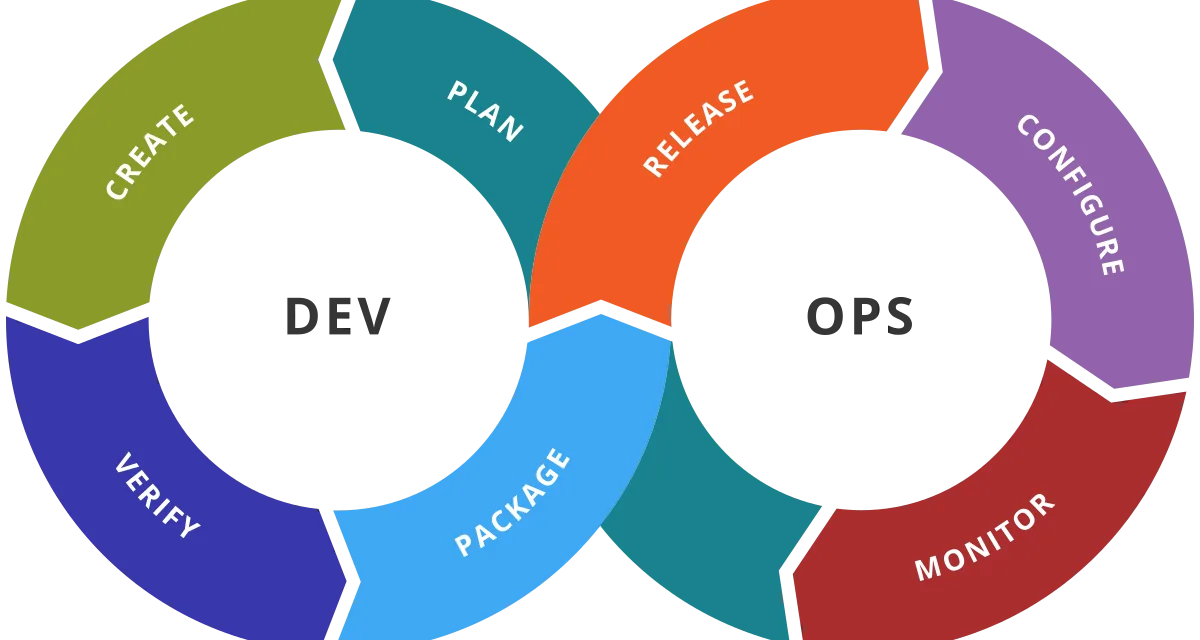

Patrones arquitectónicos que funcionan

De las arquitecturas probadas durante 2025, tres patrones muestran resultados consistentemente mejores:

- Descomposición jerárquica con supervisor. Un agente supervisor recibe la tarea, la descompone en subtareas, y delega cada una a agentes especializados con contexto acotado. El supervisor agrega resultados y entrega respuesta final. La ventaja es el control de contexto: cada subagente ve solo lo que necesita, lo que baja tokens y reduce alucinaciones.

- Workflow con estado explícito. En lugar de agente libre que decide su próximo paso de forma continua, el sistema define una máquina de estados donde cada transición está validada y el agente decide solo dentro de cada estado. Este patrón sacrifica flexibilidad pero gana trazabilidad y facilidad de depuración enorme. Plataformas como LangGraph y Temporal han popularizado el patrón.

- Herramientas con preflight y confirmación. Antes de ejecutar una acción con efecto externo (escribir en base de datos, enviar correo, llamar API de pago) el agente presenta la acción planeada y solicita confirmación, sea humana o del supervisor.

Lo que no ha funcionado bien son las arquitecturas multiagente totalmente autónomas donde múltiples agentes debaten hasta llegar a consenso. Suenan sofisticadas pero en la práctica introducen inconsistencias y costes difíciles de predecir. Varios equipos que apostaron fuerte por ese patrón en 2024 retrocedieron a arquitecturas más lineales durante 2025.

El coste real que sorprende

El coste por petición a modelo bajó significativamente durante 2025, pero el coste agregado de un agente productivo rara vez bajó en la misma proporción. La razón es que los agentes consumen mucho más contexto del que se prevé inicialmente.

El coste por tarea resuelta queda entre 0,05 y 0,30 dólares en la mayoría de casos productivos, cifras que multiplican los costes estimados ingenuamente. Un agente que atiende mil peticiones al día cuesta entre 50 y 300 dólares diarios solo en modelo. Para reducir estos costes, el ruteo por complejidad descrito en Claude Haiku 4.5 es la primera palanca.

La otra sorpresa de coste es la observabilidad. Un agente genera trazas muy densas y el almacenamiento y análisis de esas trazas consume presupuesto que muchos proyectos no previeron. Equipos con agentes en producción reportan que el coste total de observabilidad ronda el 15 a 25 por ciento del coste del modelo.

Las tareas que no encajan

El aprendizaje más claro del año es que no toda tarea es candidata a agente. Tres características hacen que una tarea sea mal candidato:

- Consecuencia alta de error pequeño. Transferencias financieras, modificaciones legales de documentos, decisiones médicas con efecto inmediato. No porque el agente no pueda acertar el 99% de las veces, sino porque el 1% cuando falla es inaceptable y el coste de verificar cada acción individualmente anula la ganancia de automatizar.

- Contexto que no está documentado. Un agente solo conoce lo que está escrito; cuando la tarea depende de conocimiento tácito del equipo, el agente falla o inventa. Antes de agentizar una tarea conviene auditar si el contexto necesario existe por escrito.

- Coste de verificación mayor que el coste de hacer la tarea. Si un experto tarda 5 minutos en hacer algo y 10 minutos en verificar que el agente lo hizo bien, automatizar no ayuda. Esta aritmética simple se olvida con frecuencia.

Un patrón de evaluación que se repite

Los equipos con éxito medible en 2025 comparten un patrón de evaluación continua. Construyen un conjunto de casos (habitualmente entre 50 y 500 casos reales) con respuesta esperada, y ejecutan el agente contra ese conjunto cada vez que hay cambio significativo de prompt, modelo o herramienta.

La inversión inicial es considerable (el conjunto de evaluación bien hecho requiere semanas de trabajo) pero el retorno aparece pronto. Sin ese conjunto, cualquier cambio es acto de fe; con él, el equipo sabe si un ajuste mejora, empeora o no cambia el rendimiento. Es la diferencia entre ingeniería y artesanía.

Cuándo compensa

Para un equipo que evalúa si poner un agente en producción, el filtro práctico queda claro. Compensa cuando:

- La tarea tiene estructura reconocible.

- El contexto necesario está documentado.

- El coste de error pequeño es absorbible.

- El equipo tiene capacidad para operar evaluación continua más allá del despliegue.

Si alguno de los cuatro falla, el agente va a dar problemas.

El aprendizaje transversal de 2025 es que los agentes son menos distintos del resto de software de lo que el marketing sugiere. Se benefician de las mismas prácticas que hacen bueno cualquier sistema productivo: observabilidad seria, evaluación continua, arquitectura con estado explícito, puntos de confirmación en lugares críticos, y humildad sobre lo que aún no se sabe resolver bien. Los equipos que tratan a los agentes como ingeniería aburrida en vez de milagro conversacional son los que acaban con sistemas que funcionan.