SLSA lleva año y medio en su versión 1.0 y el ecosistema ha tenido tiempo de adoptarlo. Repaso de lo que funciona, lo que sigue costando y por dónde tiene sentido empezar.

Leer máso1-preview: el modelo de OpenAI que piensa antes de responder

OpenAI presentó o1 en septiembre 2024. Un modelo que razona internamente antes de contestar. Qué cambia y cuándo merece la pena.

Leer másPrincipios de software verde: una checklist para equipos

El software consume energía. Reducir su huella de carbono no es sólo virtud — es ahorro operativo. Ocho principios prácticos aplicables desde mañana.

Leer másTerraform 1.6 en adelante: novedades tras el cambio de licencia

Terraform 1.6+ traen import blocks, removed block, stacks. Mientras OpenTofu divide, HashiCorp continue shipping features.

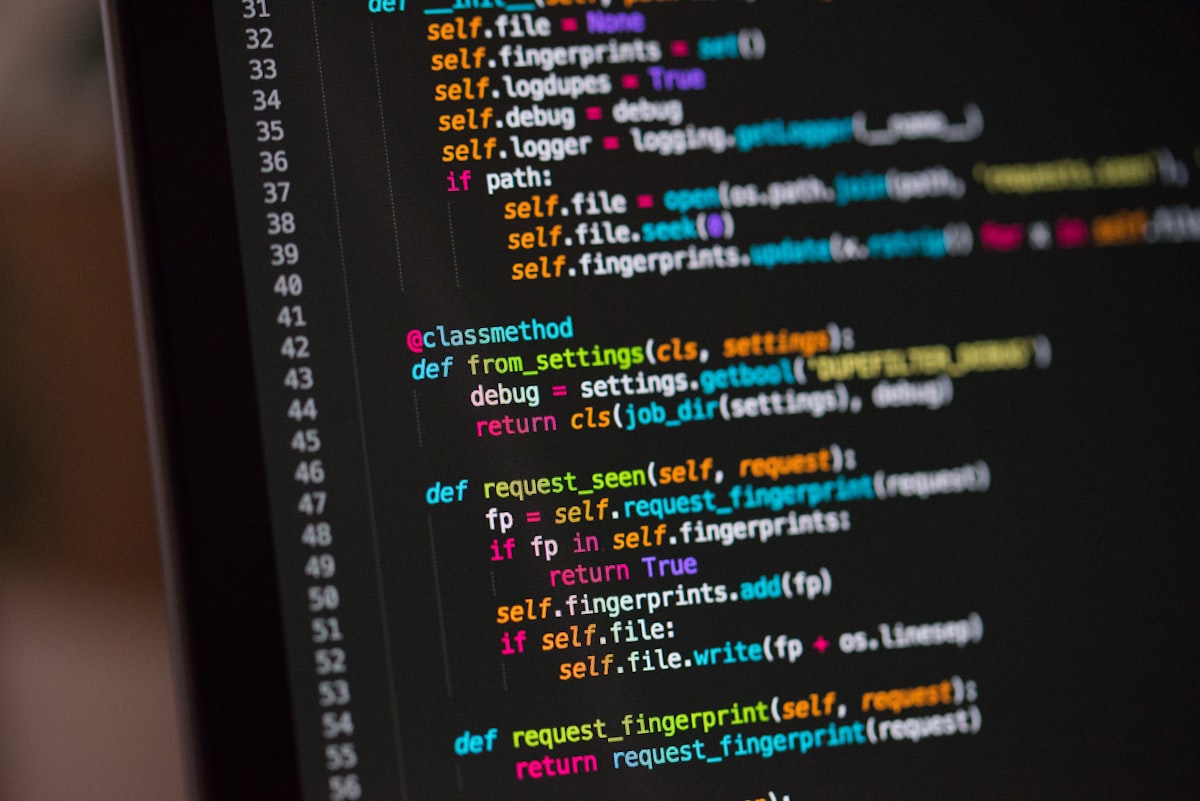

Leer másPython 3.12: aceleración y trazado más útil

Python 3.12 trajo type parameter syntax, 5% perf, tracing mejorado. Compatibility stable, upgrade path safe.

Leer másBúsqueda híbrida: combinar BM25 y vectores en serio

Solo vector o solo keyword pierden casos. Hybrid search combina BM25 + semantic via RRF. Cómo y cuándo.

Leer másIEC 62443: ciberseguridad OT explicada para equipos IT

IEC 62443 es el marco de ciberseguridad industrial. Cómo IT teams pueden aplicarlo y coordinar con OT sin colisiones.

Leer másllama.cpp: optimizaciones que siguen sorprendiendo

llama.cpp is foundation. 2024 brought speculative decoding, RPC, GPU improvements. Cuándo usar directly vs via Ollama.

Leer másOllama en 2024: ejecutar LLM localmente sin dolor

Ollama consolidó como standard para LLMs locales. Features 2024, models catalog, integración apps y cuándo usar vs vLLM.

Leer másModel Context Protocol: la propuesta abierta de Anthropic

Anthropic lanzó MCP como standard abierto para conectar LLMs a datos/tools. Por qué importa y cómo usar servers MCP.

Leer más