Hace un año escribí que el diseño de interfaces para agentes LLM estaba empezando a salir del monocultivo del chat, que aparecían patrones propios y que algunos eran moda pasajera. Dieciocho meses después, con millones de usuarios usando agentes a diario en Copilot, ChatGPT, Claude, Gemini, Cursor y una larga lista de productos menos visibles, el paisaje ha decantado. Ya no es razonable hablar de que “está todo por decidir”; hay un consenso de diseño formado, con patrones que cualquier producto nuevo puede asumir como punto de partida. Toca recoger lo que ha quedado.

El chat sigue siendo la base, pero no el todo

El punto de partida, discutido hace dos años, hoy es evidente: el chat con historial y área de burbujas sigue siendo la interfaz primaria cuando la tarea es exploratoria, cuando el usuario no sabe exactamente qué quiere pedir o cuando la interacción es conversacional por naturaleza. Nada lo ha desplazado en ese nicho. Lo que ha cambiado es la aceptación de que no es la única interfaz válida y que forzarlo en tareas donde no encaja produce peor experiencia.

El chat funciona porque tiene la mínima fricción para entrada libre, permite al usuario no estructurar su pensamiento antes de hablar y deja al agente manejar ambigüedad. Donde deja de funcionar es cuando la tarea es estructurada, cuando el usuario ya sabe exactamente qué quiere o cuando el resultado necesita presentación que el hilo lineal no da. Identificar cuándo el chat deja de ser adecuado es la primera decisión de diseño en productos con agentes.

El patrón de agente en segundo plano ha ganado

El patrón que más claramente ha ganado durante 2025 es el de agente ejecutando tareas en segundo plano con panel de progreso explícito. GitHub Copilot Workspace, Devin, Cursor en modo agente y varios productos similares han convergido en la misma idea: el usuario pide una tarea compleja, el agente empieza a trabajar mostrando sus pasos en una columna lateral o en un panel dedicado, y el usuario puede seguir haciendo otras cosas. El agente avisa cuando termina o cuando necesita decisión.

Este patrón funciona porque alinea el modelo mental del usuario con lo que el agente realmente hace. Cuando una tarea requiere varios minutos, el usuario no quiere estar esperando mirando una burbuja; quiere poder hacer otra cosa y que el trabajo se entregue cuando esté. La visibilidad del progreso evita que el usuario sospeche que el sistema se ha colgado, y la capacidad de interrumpir o reorientar mantiene el control humano sin sobrecargar la interfaz.

La regla emergente es clara: si una tarea va a tomar más de treinta segundos, el agente debería operar en segundo plano con progreso visible, no bloquear la conversación. Esto requiere arquitectura que separa la sesión de ejecución de la sesión de chat, cosa que hace dos años costaba pero que hoy tienen resuelta todos los frameworks serios de agentes.

Entradas estructuradas cuando el usuario ya sabe qué quiere

El segundo patrón consolidado es el retorno de formularios e interfaces estructuradas cuando la tarea encaja. Durante 2024 hubo un periodo de rechazo estético a los formularios, empujado por el entusiasmo con chat, que llevó a productos que obligaban a describir en lenguaje natural cosas que el usuario ya sabía expresar como parámetros. El resultado fue fricción innecesaria. A lo largo de 2025, los equipos con disciplina recuperaron formularios para entradas estructuradas, con chat solo como complemento para el tramo exploratorio de la tarea.

Un ejemplo canónico es cualquier herramienta de generación de imágenes en 2026. La interfaz ganadora no es sólo prompt libre; es prompt libre más controles explícitos para dimensiones, estilo, aspecto, referencias. El usuario que no sabe qué quiere usa el prompt libre; el que sí sabe ajusta parámetros sin tener que rogar al agente con lenguaje natural para conseguir exactamente lo mismo.

La generalización del patrón es: cuando el espacio de decisiones del usuario es finito y conocido, dale controles explícitos. Cuando es abierto, dale conversación. La mayoría de tareas reales son mezcla, y la interfaz ganadora refleja esa mezcla.

La sala de hilos de trabajo

Tercer patrón consolidado: productos que manejan múltiples tareas simultáneas del mismo usuario usan una lista lateral de hilos de trabajo, cada uno con estado propio, progreso propio y resultado propio. ChatGPT con sus chats separados, Claude con proyectos, Cursor con chats por repositorio y una larga lista han convergido en este modelo. El usuario no tiene un hilo único con todo; tiene muchos hilos paralelos organizados por contexto.

Este patrón evita la pesadilla del chat sin fin donde todo el trabajo histórico se apila en una única conversación. Permite archivar, retomar, comparar y compartir hilos concretos. Y se alinea bien con cómo funciona el trabajo real: rara vez es una sola tarea continua; son muchas cosas paralelas con distintos estados de madurez.

La variante empresarial es agrupar hilos en proyectos o espacios de trabajo, con permisos compartidos y contexto común. Claude Projects es uno de los ejemplos más limpios, pero Microsoft Copilot Studio, Notion AI y varios productos verticales han llegado a patrones equivalentes con nombres distintos.

El control humano explícito en el bucle

Un patrón que costó pelearlo pero ya se ha impuesto es que las acciones irreversibles o críticas deben requerir confirmación explícita del humano, incluso cuando el agente tiene capacidad técnica para ejecutarlas. Publicar un correo, commitear código a rama principal, ejecutar un pago, borrar datos: todas son acciones que en 2026 ningún producto serio deja al agente completar sin al menos una confirmación humana que resuma claramente lo que va a pasar.

El diseño específico varía, desde botones explícitos hasta resúmenes estructurados, pero el principio es firme. Los productos que experimentaron con agentes plenamente autónomos sufrieron incidentes suficientemente graves durante 2024 y 2025 como para que la industria haya aprendido. Incluso cuando el agente lleva la carga cognitiva del noventa y cinco por ciento de la tarea, el cinco por ciento final de confirmación humana es lo que distingue un producto maduro de uno que está esperando un desastre.

La variante más elaborada es el modo dry-run, donde el agente describe exactamente qué hará antes de hacerlo, con detalle técnico suficiente para que el humano pueda validar o corregir. Esto se ha vuelto estándar en agentes de código, donde ver el diff antes de aplicarlo evita sorpresas catastróficas.

Las modas que no cuajaron

No todos los patrones probados durante 2025 han quedado. Los avatares animados del agente, con caras que expresan emoción mientras responden, no han funcionado: añaden fricción visual sin aportar información y la mayoría de usuarios los desactivan. Sobreviven en productos muy específicos con público adulto o infantil donde la persona animada tiene sentido cultural; para productividad general son distracción.

La interfaz de voz como sustituto del chat ha quedado confinada a casos concretos: manos libres, accesibilidad, entornos móviles específicos. Para uso de escritorio cotidiano, el chat escrito sigue siendo más rápido y más preciso, porque el usuario puede revisar antes de enviar y el agente puede formatear respuestas que la voz no maneja bien. La voz bidireccional fluida es posible técnicamente, pero la ergonomía real la limita a nichos.

La realidad virtual para interfaz con agentes nunca arrancó fuera de experimentos aislados. Las razones son las mismas que hundieron el metaverso en general: fricción de hardware, falta de caso de uso que justifique el dispositivo, fatiga visual. Los agentes están en pantallas planas y van a seguir estando en pantallas planas durante todo el horizonte predecible.

Mi lectura

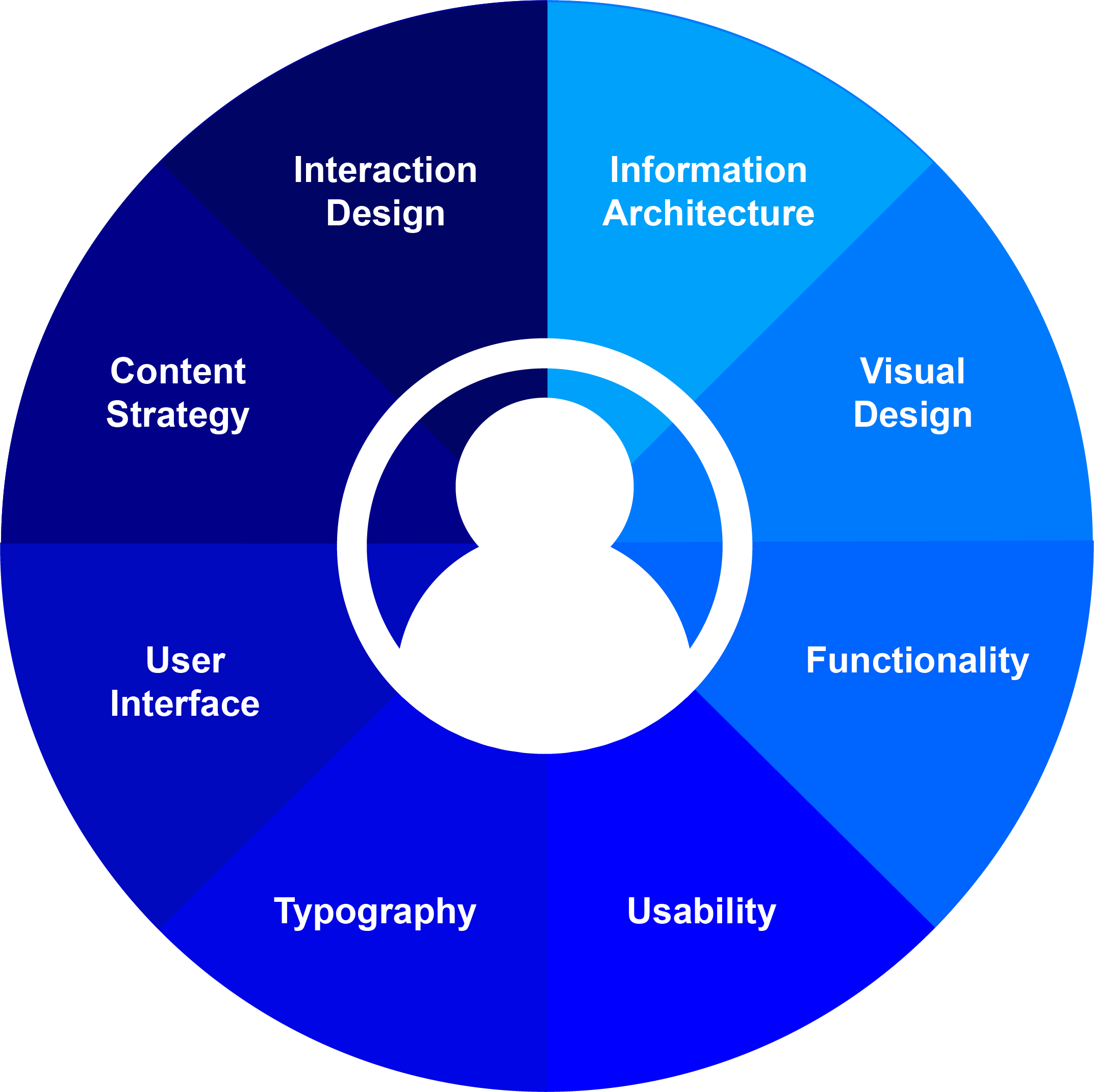

El consenso de diseño UX para agentes en enero de 2026 se puede resumir en cinco principios operativos. Primero, chat como base cuando la tarea es exploratoria o conversacional, no como respuesta única. Segundo, agente en segundo plano con panel de progreso para tareas largas. Tercero, controles estructurados cuando el espacio de decisión es finito y conocido. Cuarto, hilos de trabajo paralelos con organización por contexto o proyecto. Quinto, confirmación humana explícita en acciones irreversibles o críticas.

Estos cinco principios cubren probablemente el noventa por ciento de las decisiones de diseño que un producto con agentes debe tomar hoy. No son invención de nadie en particular; son convergencia independiente de muchos equipos trabajando sobre los mismos problemas durante dos años. El beneficio para cualquiera que arranque diseño con agentes en 2026 es que puede empezar aquí sin reinventar, ahorrando el año que costó a los primeros descubrirlos.

La siguiente frontera, dónde los patrones aún están por estabilizar, es la coordinación entre múltiples agentes actuando en la misma tarea (relacionada con el protocolo A2A v1), la memoria a largo plazo reusable entre sesiones y la colaboración entre agentes y humanos en tiempo real en documentos vivos. Ahí sigue habiendo espacio para inventar. En el resto, los patrones ya están y el trabajo es aplicarlos con cuidado y sin sobreingeniería.