Datos sintéticos para entrenamiento en 2026: cuándo funcionan

Índice de contenidos

Actualizado: 2026-04-30

Durante 2023-2024 los datos sintéticos eran el último recurso cuando no había reales. En 2026 son parte central de casi cualquier pipeline de entrenamiento o fine-tuning serio. Esto es lo que ha cambiado y lo que sigue requiriendo criterio.

Puntos clave

- Generación de variaciones a partir de un núcleo real (500 ejemplos → 10.500) es el caso de uso más fiable.

- El “model collapse” ocurre al entrenar puramente sintético durante varias generaciones: el modelo pierde las colas de la distribución.

- La mezcla mínima segura es al menos 30% de datos reales, incluso cuando la generación sintética es barata.

- Tres validaciones obligatorias: diversidad, corrección (muestra revisada por humanos) y distribución.

- El coste de validación es el 10-20% del tiempo total del pipeline y se amortiza en el primer modelo roto evitado.

Donde funcionan sin reservas

Generación de variaciones a partir de un núcleo real. El patrón más probado:

- Tienes 500 ejemplos etiquetados.

- Generas 10.000 parafraseos controlados preservando la etiqueta.

- Entrenas sobre 10.500.

Esto amplía la distribución y mejora la robustez. La clave es que el núcleo es real; la expansión es sintética.

Otros casos donde funciona bien:

- Generación adversarial para red teaming: casos difíciles que destapan fallos del modelo.

- Generación de tests de regresión a partir de especificaciones.

Donde sigue fallando

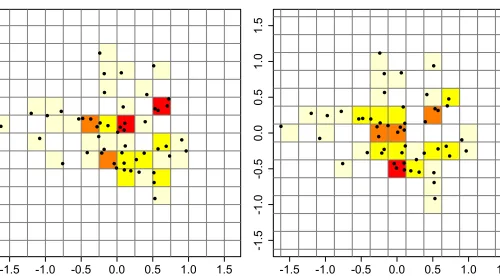

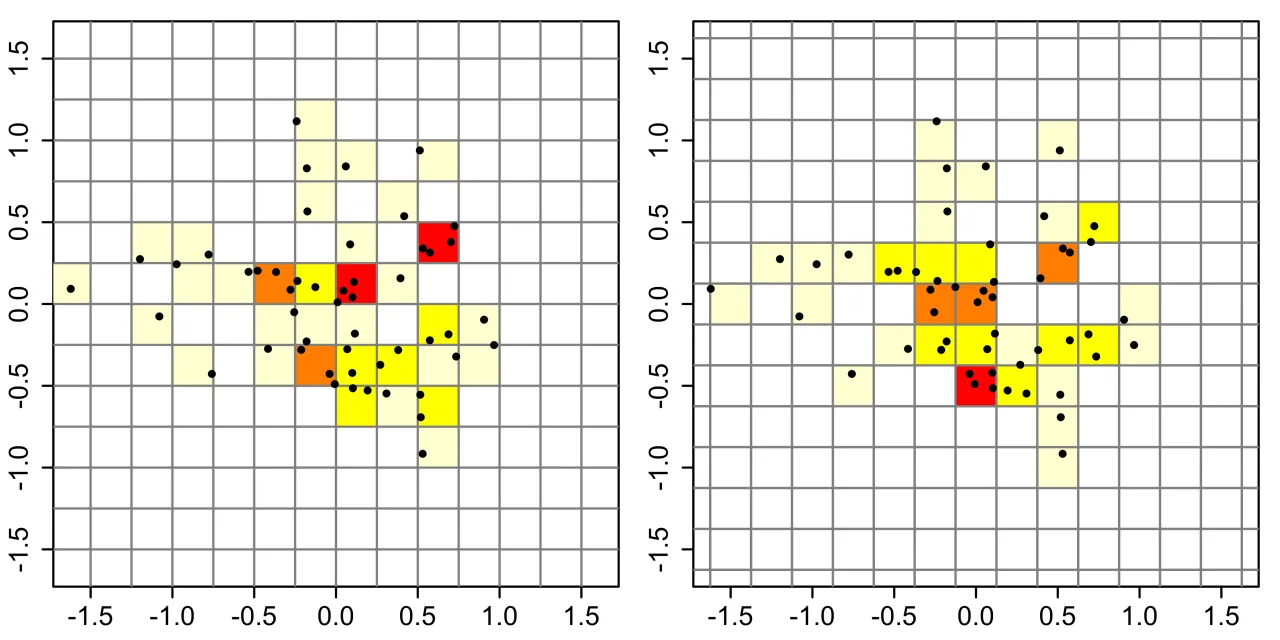

Generación de ejemplos completamente sintéticos sin anclaje real para entrenar un modelo desde cero. Research reciente sobre “model collapse”[1] demuestra que entrenar sobre datos puramente sintéticos durante varias generaciones:

- Degrada la calidad del modelo.

- El modelo converge a la distribución media del generador.

- Pierde las colas de la distribución, que contienen los casos difíciles e importantes.

Mitigación: mezclar siempre con porcentaje significativo de datos reales (al menos 30%). Los equipos serios mantienen este ratio incluso cuando la generación sintética es barata y los datos reales caros.

Validación obligatoria

Generar datos sintéticos sin validarlos es entrenar a ciegas. Tres validaciones mínimas:

- Diversidad: no repetir estructuralmente; los parafraseos deben añadir variabilidad real.

- Corrección: las etiquetas sintéticas son correctas en una muestra revisada por humanos.

- Distribución: la mezcla sintético+real mantiene las propiedades estadísticas del corpus real.

Herramientas:

El coste de validación es del 10–20% del tiempo total del pipeline. Se amortiza el primer modelo roto evitado.

Conclusión

Datos sintéticos en 2026 son palanca real con reglas claras: anclar en datos reales, validar siempre, evitar entrenar puramente sintético, medir impacto. Usados así, amplían la capacidad de entrenamiento a un factor de 10× o 20× sin degradación. Usados sin criterio, degradan el modelo silenciosamente sin que nadie lo detecte hasta que el daño está hecho.