DPO y alternativas a RLHF: estado práctico en 2026

Más sobre este artículo

Resumen rápido

- RLHF fue el alineamiento dominante 2022-2024, pero su complejidad (actor, crítico, recompensa) lo hace caro e inestable.

- DPO elimina el modelo de recompensa separado y reduce el tiempo de entrenamiento un 60-80%, con calidad comparable.

- Consenso 2026: DPO como default; IPO para datos ruidosos, KTO sin pares, SimPO cuando el cómputo es crítico.

- La calidad del dato sigue siendo el factor limitante; ningún método rescata datasets malos.

Conceptos clave

- Por qué RLHF ha perdido terreno: Sus tres componentes simultáneos y alta sensibilidad a hiperparámetros lo hacen caro, difícil de reproducir e inestable fuera de equipos con gran experiencia.

- DPO, IPO, KTO, SimPO: Cuatro variantes de alineamiento por preferencias directas que ofrecen distintas compensaciones entre calidad, coste y requisitos de datos.

- Cuándo RLHF sigue valiendo: Solo en frontier models de miles de millones de parámetros con presupuesto elevado; fuera de ese nicho, DPO supera en relación coste-beneficio.

Enlaces útiles

Sigue leyendo

Actualizado: 2026-05-16

RLHF (Reinforcement Learning from Human Feedback) fue el método dominante de alineamiento de modelos desde 2022 hasta 2024. En 2025-2026, un conjunto de alternativas más simples y baratas, DPO y sus primas, ha pasado de investigación académica a uso habitual en la mayoría de pipelines de fine-tuning. Este es el estado del campo hoy.

Puntos clave

- RLHF requiere tres componentes (actor, crítico, recompensa) con alta sensibilidad a hiperparámetros: caro, difícil de reproducir.

- DPO elimina el modelo de recompensa separado y usa preferencias directamente; pipeline más simple, reproducible y 60-80% más rápido.

- Consenso 2026: DPO como default, IPO si el dataset tiene ruido alto, KTO si no puedes generar pares, SimPO cuando el coste computacional es crítico.

- RLHF sigue teniendo sentido en frontier models con presupuesto grande; fuera del top tier, DPO gana en coste-beneficio.

- La calidad del dato sigue siendo el limitante; DPO no rescata datasets malos.

Por qué RLHF ha perdido terreno

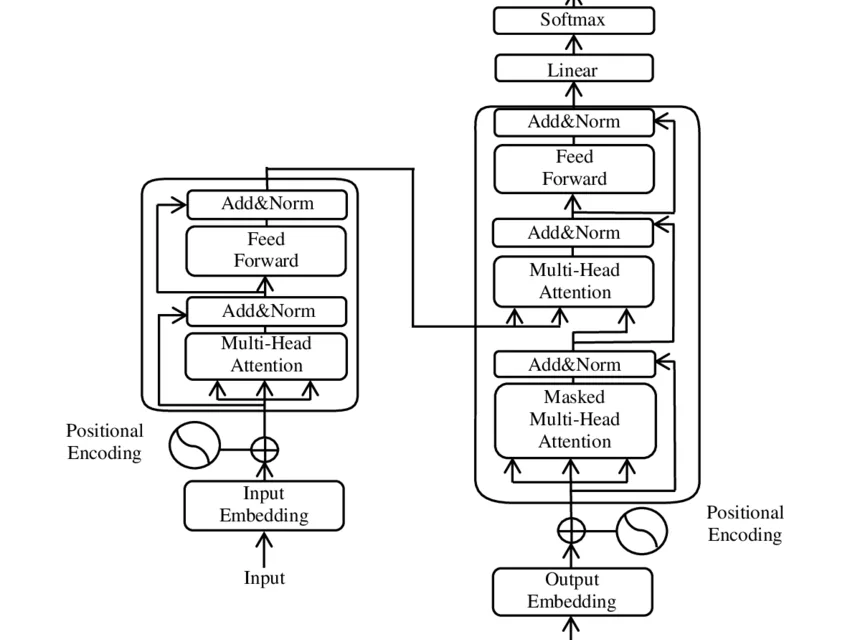

RLHF requiere:

- Entrenar un modelo de recompensa separado.

- Hacer RL sobre el LLM.

- Gestionar tres componentes simultáneos: actor, crítico y recompensa.

Alta sensibilidad a hiperparámetros. En la práctica:

- Caro de entrenar.

- Difícil de reproducir entre runs.

- Inestable en manos inexperimentadas.

DPO elimina el modelo de recompensa separado. Usa directamente las preferencias humanas como señal de entrenamiento con una función de pérdida elegante que matemáticamente equivale a RL bajo ciertos supuestos. Resultado: pipeline más simple, más barato, más reproducible.

DPO, IPO, KTO, SimPO

Las cuatro variantes principales:

- DPO[1] (Direct Preference Optimization): la línea base. Default para la mayoría de casos.

- IPO (Identity Preference Optimization): corrige algunos sesgos de DPO en datasets imperfectos con ruido alto.

- KTO (Kahneman-Tversky Optimization): usa señal binaria en lugar de pares. Útil cuando solo tienes “bueno/malo” sin pares comparados.

- SimPO: simplifica más aún eliminando el modelo referencia. Para cuando el coste computacional es crítico.

Consenso en 2026:

- DPO como default.

- IPO si el dataset tiene ruido alto.

- KTO si no puedes generar pares.

- SimPO cuando el coste computacional es crítico.

Cuándo sigue haciendo sentido RLHF

Para frontier models con:

- Escalas de miles de millones de parámetros.

- Budgets grandes.

RLHF todavía produce resultados marginalmente mejores en algunos benchmarks. Pero la ventaja es pequeña y el coste enorme. Fuera del top tier, DPO gana en relación coste/beneficio.

Resultados prácticos reportados

Equipos que han migrado RLHF→DPO reportan:

- Reducción del 60–80% en tiempo de entrenamiento.

- Calidad comparable en evaluaciones humanas.

- Mayor estabilidad entre runs.

La migración típica toma entre una y dos semanas de ingeniería.

Lo que no cambia

El dato sigue siendo el limitante. DPO no rescata datasets malos; los procesa más eficientemente. La calidad del alineamiento sigue dependiendo de la calidad de las preferencias humanas, o sintéticas bien validadas, que alimentan el proceso.

Conclusión

DPO y alternativas han democratizado el alineamiento. Un equipo pequeño puede alinear su fine-tune con recursos razonables usando DPO, cuando hace dos años requería infraestructura de investigación. El campo ha madurado; la barrera de entrada ha bajado. Para quien entrena modelos aplicados hoy, DPO es probablemente el default correcto.