Cómo evaluar un sistema RAG sin engañarte a ti mismo

Actualizado: 2026-05-03

Construir un sistema RAG es relativamente sencillo. Decidir si funciona bien es mucho más difícil. Muchos equipos despliegan sistemas que parecen impresionantes en demos internas y decepcionan en producción porque nunca establecieron un proceso riguroso de evaluación. Este artículo cubre cómo medir la calidad de un RAG honestamente, qué métricas usar, cómo construir conjuntos de evaluación y los errores más comunes.

Puntos clave

- La intuición engaña: un puñado de preguntas que el ingeniero construyó no es evaluación rigurosa.

- Las cuatro dimensiones clave son fidelidad, relevancia de respuesta, precisión de contexto y cobertura de contexto.

- El conjunto dorado es el activo más valioso: 100-500 preguntas curadas representan casos reales, difíciles y fuera-de-alcance.

- El LLM como juez es escalable pero tiene sesgos — validar periódicamente con humanos es obligatorio.

- Integrar evaluación en el pipeline de CI es la diferencia entre mejorar y creer que se mejora.

Por qué la intuición engaña

La tentación natural al evaluar un sistema RAG es probar un puñado de preguntas, ver respuestas aparentemente razonables, y declarar éxito. Este enfoque falla por varias razones:

- Las preguntas que un ingeniero construye para probar son distintas de las que los usuarios reales formularán.

- Los casos fáciles son sobrerrepresentados.

- El sesgo de confirmación lleva a interpretar respuestas ambiguas como correctas.

- La variabilidad entre modelos es alta y una muestra pequeña no la captura.

Sin medición estructurada, el equipo desarrolla mejoras sin saber si mejoran algo. Peor aún, pueden empeorar sin darse cuenta hasta que los usuarios se quejan.

Las cuatro dimensiones clave

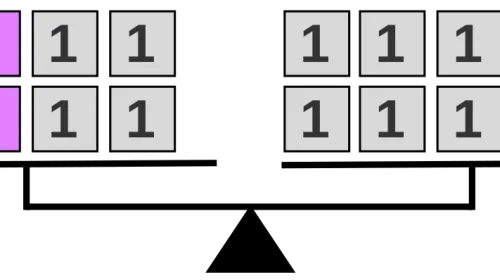

La calidad de un RAG no es una métrica única sino una combinación. Las cuatro dimensiones que capturan la mayoría de problemas son:

Fidelidad: mide si la respuesta está respaldada por el contexto recuperado. Una respuesta puede ser plausible pero contener información que el contexto no soportaba — alucinaciones. Detectar esto requiere comparar cada afirmación de la respuesta con el contexto.

Relevancia de la respuesta: mide si la respuesta efectivamente responde la pregunta formulada. Un sistema puede devolver respuestas correctas pero tangenciales al intent del usuario.

Precisión del contexto: mide qué fracción del contexto recuperado es realmente relevante para la pregunta. Recuperar cien documentos de los cuales solo dos son útiles penaliza al generador y genera ruido.

Cobertura del contexto: mide si el contexto recuperado contiene toda la información necesaria para responder completamente. Requiere una respuesta de referencia para comparar.

Frameworks como Ragas automatizan el cálculo de estas métricas usando un LLM como juez. TruLens ofrece una visión similar con variaciones. Para empezar, Ragas es punto de entrada pragmático. La calidad del retrieval que alimenta estas métricas depende directamente de la estrategia que elegiste: búsqueda híbrida vs vector puro tiene impacto medible en fidelidad y cobertura.

Construir un conjunto dorado

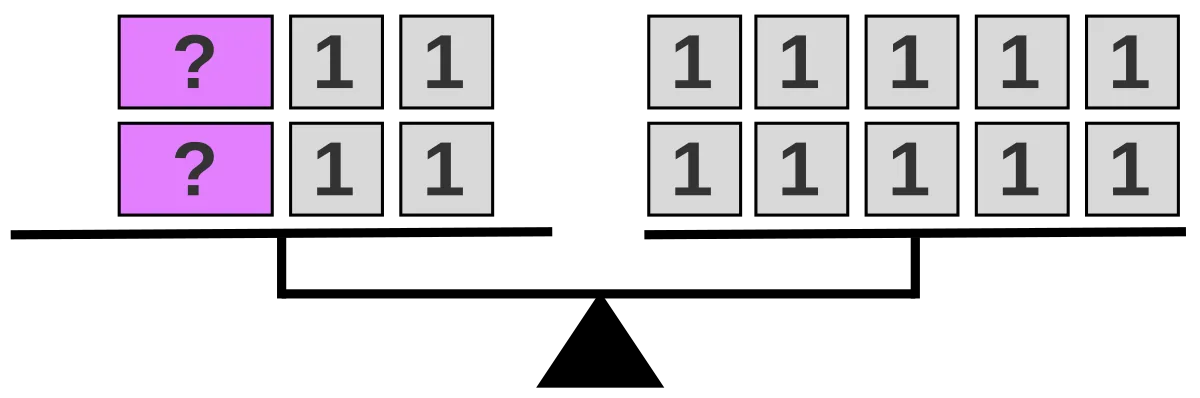

El activo más valioso en la evaluación de un RAG no es el framework sino el conjunto dorado — un conjunto cuidadosamente curado de pares pregunta-respuesta que representan casos reales.

El punto de partida son los logs reales de usuarios si ya tienes producción. Si es sistema nuevo, entrevistas con usuarios objetivo y expertos de dominio generan las preguntas más realistas. Un conjunto dorado típico tiene entre 100 y 500 preguntas, con cobertura deliberada de:

- Casos fáciles (preguntas directas con respuesta clara).

- Casos medios (requieren síntesis de varias fuentes).

- Casos difíciles (razonamiento complejo o información dispersa).

- Casos ambiguos (donde la respuesta correcta es debatible).

- Casos fuera-de-alcance (preguntas que el sistema no debería responder).

Para cada pregunta, el conjunto dorado debe incluir la respuesta correcta (curada por humanos) y, opcionalmente, los documentos de la base de conocimiento que deberían recuperarse. Este último detalle permite medir recall del retrieval independiente de la generación.

El mantenimiento del conjunto dorado es actividad continua. A medida que el producto evoluciona y nuevos casos emergen, se añaden preguntas. El conjunto nunca está completo pero debe ser representativo.

LLM como juez: usos y límites

Muchas evaluaciones modernas usan un LLM como juez para calificar respuestas. Es escalable y relativamente barato. Pero tiene limitaciones que conviene entender:

- El juez LLM tiende a preferir respuestas más largas, más formales, con estructura más sofisticada.

- Puede ser demasiado lenient en ciertos errores sutiles que humanos detectarían.

- Si se usa el mismo modelo tanto para generar como para juzgar, el sesgo es aún mayor.

La mitigación habitual pasa por:

- Usar un modelo distinto al generador para juzgar.

- Validar regularmente con muestreo humano.

- Usar prompts de evaluación cuidadosamente diseñados.

- Usar varios jueces LLM y promediar — consenso entre tres modelos reduce sesgos individuales.

Nunca conviene usar solo LLM como juez sin validación humana periódica. Un muestreo mensual de 50 respuestas revisadas por humano, comparado con el veredicto automático, muestra si el juez está calibrado con realidad.

Evaluación continua en el pipeline

Una vez construido el conjunto dorado y definidas las métricas, la evaluación debe integrarse en el ciclo de desarrollo. Cada cambio de prompt, cada cambio de modelo, cada cambio de chunking debería pasar por la evaluación automatizada antes de merge.

El patrón que funciona en producción incluye umbrales en las métricas clave:

- Si la fidelidad cae debajo del 0.8, el build falla.

- Si la relevancia de respuesta cae más de un 5% respecto a la línea base, alerta.

Los umbrales se calibran con datos históricos. Adicionalmente, muestras de tráfico real en producción deben pasar por evaluación continua — no solo el conjunto dorado. Esto detecta derivas cuando los usuarios empiezan a formular preguntas fuera de los patrones originalmente anticipados.

Errores comunes

Los patrones de error que aparecen una y otra vez:

- Optimizar métricas que no correlacionan con satisfacción del usuario: un sistema puede tener fidelidad alta pero respuestas que el usuario percibe como inútiles. La validación con usuarios reales es irremplazable.

- Conjunto dorado demasiado fácil: si el sistema obtiene 95% en todas las métricas pero los usuarios se quejan, el conjunto no captura la dificultad real. Añadir casos difíciles deliberadamente es sano.

- No versionar el conjunto dorado con el código: si el conjunto cambia sin trazabilidad, no se pueden comparar resultados entre versiones del sistema. Git es suficiente.

Coste y tiempo

Evaluar un conjunto de 500 preguntas con un LLM frontier como GPT-4o cuesta entre 10 y 50 euros por ejecución, dependiendo de la longitud de las respuestas y del número de métricas. Para releases frecuentes, ajustar tamaño del conjunto o usar modelos más baratos en CI diario y el conjunto completo solo en releases.

El tiempo de evaluación también es real. 500 preguntas con varias métricas pueden tardar entre 15 y 60 minutos. Paralelizar es posible pero no siempre trivial.

Métricas cualitativas complementarias

Las métricas cuantitativas no capturan todo. Señales cualitativas importantes:

- Feedback explícito de usuarios (pulgares arriba/abajo).

- Tiempo que los usuarios pasan con cada respuesta.

- Tasa de seguimiento con pregunta relacionada.

- Tasa de abandono.

Un sistema con métricas automáticas excelentes pero tasa alta de abandono de usuarios tiene problema que las métricas no capturan. Combinar ambas fuentes da visión completa.

Conclusión

Evaluar un RAG con rigor es la diferencia entre un sistema que funciona bien y uno que parece funcionar bien. El coste de implementar evaluación continua es moderado; el coste de no hacerlo es sistemas que decepcionan en producción sin que el equipo sepa por qué. Herramientas como Ragas democratizaron la infraestructura; el conjunto dorado y la disciplina de medir consistentemente son ahora la parte difícil. Para equipos que arrancan, un conjunto mínimo de 50 preguntas bien seleccionadas y las cuatro métricas básicas ya es salto enorme respecto a evaluar sin estructura.