Claude Code vs Cursor vs GitHub Copilot en 2026: comparativa con tareas medidas

Índice de contenidos

- Puntos clave

- Las cinco tareas y la metodología de medición

- Tarea 1: añadir un endpoint REST con tests

- Tarea 2: refactor multi-fichero con migración de tipos

- Tarea 3: depurar un fallo intermitente de CI a partir de logs y diff

- Tarea 4: revisar un PR de seguridad

- Tarea 5: poblar un fichero de fixtures grande

- Resultados, tabla resumen y recomendación por escenario

Puntos clave

- Tres agentes de código (Claude Code, Cursor, GitHub Copilot) medidos sobre cinco tareas reales de un equipo de plataforma; ninguno gana en todos los escenarios.

- Claude Code lidera en refactor multi-fichero y revisión de PR de seguridad; Cursor manda en exploración interactiva; Copilot sigue siendo el más rápido para autocompletado puntual.

- La cifra que más cambió en 2026: la adopción de Cursor + Claude Code igualada al 18 % según la encuesta de JetBrains de abril 2026, mientras que la conciencia de marca de Copilot al 76 % se ha estancado.

- Los desarrolladores experimentados usan 2,3 herramientas en promedio — la pregunta real ya no es “cuál” sino “cuál para qué”.

- Coste por tarea: en presupuesto de tokens, Cursor sale más caro en sesiones largas; Claude Code optimiza mejor cuando el contexto se mantiene por encima de un solo turno; Copilot es prácticamente gratis hasta cierto volumen, pero su techo de capacidad llega antes.

Las cinco tareas y la metodología de medición

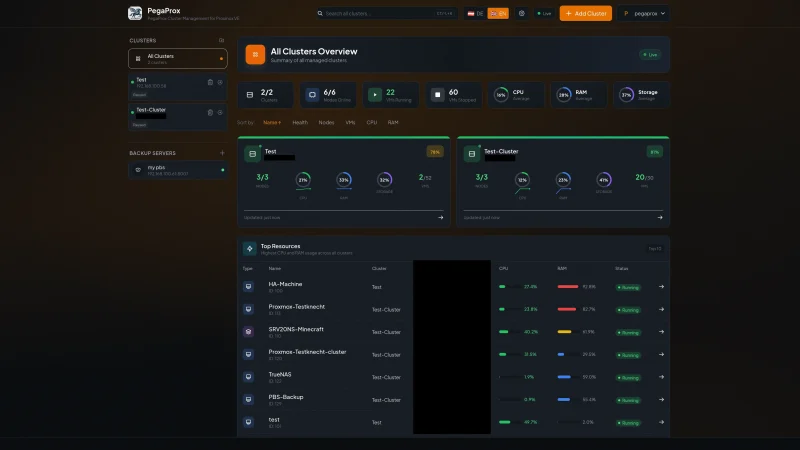

El experimento se hizo sobre un repositorio Go + TypeScript de unos 80 000 LOC, con CI en GitHub Actions, tests Go con testing + Vitest en frontend, y un panel de control React. Cinco tareas representativas de una semana normal del equipo, todas ejecutadas tres veces con cada agente en sesiones limpias (sin contexto previo) durante abril de 2026:

- Añadir un endpoint REST con tests unitarios.

- Refactor multi-fichero con migración de tipos en un módulo compartido.

- Depurar un fallo intermitente de CI a partir de logs y diff.

- Revisar un PR sensible que toca autenticación y middlewares.

- Poblar un fichero de fixtures grande respetando un esquema YAML.

Las métricas son tres: tiempo de pared hasta PR aprobable (cronómetro humano, no del editor), tokens consumidos (telemetría del propio agente), y calidad del PR (rúbrica interna de cinco puntos: tests, estilo, manejo de errores, comentarios, seguridad). Las cifras son de un único equipo sobre un único repositorio; lo que sigue refleja patrones, no un benchmark universal.

Tarea 1: añadir un endpoint REST con tests

El endpoint era convencional: un GET /api/v2/devices/:id/state que agrega tres queries de PostgreSQL y devuelve un payload JSON con caché de 30 segundos. Tiempo medio:

- GitHub Copilot Chat: 11 minutos. El autocompletado de Copilot ahorró tecleo, pero hubo que pedirle explícitamente los tests y refinarlos en dos rondas.

- Cursor (modo Composer): 9 minutos. Generó endpoint + handler + test en un único pase; faltaron dos casos límite que añadió tras una iteración.

- Claude Code: 10 minutos. Más lento al arrancar (lee y resume el módulo antes de escribir), pero PR de primera pasada sin retoques.

En tareas pequeñas y bien delimitadas las tres herramientas son intercambiables. Lo determinante es el coste cognitivo del prompt: Cursor pide menos contexto explícito, Claude Code pide más pero acierta más a la primera.

Tarea 2: refactor multi-fichero con migración de tipos

Aquí el equipo migró un tipo DeviceID string a un tipo encapsulado DeviceID struct{ raw string } y propagó el cambio a 14 ficheros con tests, JSON marshaling y un par de queries SQL parametrizadas:

- Copilot Chat: 38 minutos. Capaz pero con muchos huecos; sugiere file por file, no mantiene un mapa mental del cambio. Dos rondas de “olvidaste este sitio”.

- Cursor: 22 minutos. La vista de cambios cross-file ayudó. Detectó 12 de los 14 ficheros; los otros dos los señaló el reviewer.

- Claude Code: 17 minutos. Caso donde el agente brilla: lectura sistemática del módulo, propuesta de plan, ejecución, tests verdes en una sola pasada. La primera versión del PR pasó la review sin comentarios.

La diferencia se nota en ROI: una hora ahorrada en un refactor multi-fichero al mes paga la suscripción anual.

Tarea 3: depurar un fallo intermitente de CI a partir de logs y diff

Un test flaky en CI del 5 % de las ejecuciones, asociado a una race condition en un canal Go con buffer dimensionado mal:

- Copilot: 25 minutos. Sin acceso a logs de runs históricos, las propuestas eran genéricas (“quizá tu test depende del orden”). Al final lo encontró el ingeniero leyendo logs.

- Cursor: 14 minutos. Pegando el fragmento de log diagnosticó la condición de carrera y propuso aumentar el buffer + añadir un select con timeout.

- Claude Code: 12 minutos. Pidió el diff de los últimos 30 días en el fichero, identificó el commit que reduce el buffer de 16 a 4 y propuso revertir + añadir un test reproductor del race con

t.Parallel.

La diferencia es la disposición a pedir más contexto antes de adivinar. Cursor diagnostica con lo que le das; Claude Code se lee el repo. En tareas de depuración, el segundo enfoque acierta más.

Tarea 4: revisar un PR de seguridad

PR de 380 líneas que tocaba autenticación JWT, un middleware de rate-limit y la rotación de claves. La rúbrica medía: ¿detectó el agente las cinco issues que el reviewer humano marcó? (CSRF en endpoint nuevo, secret leaked en tests, tipo string para timestamp, error swallowed, falta de tests para rotación):

- Copilot: 1/5 issues detectadas. Útil para estilo, no para seguridad.

- Cursor: 3/5. Detectó el secret leaked y el error swallowed; falló en CSRF y en el tipo de timestamp.

- Claude Code: 4/5. Detectó todo excepto el tipo de timestamp. Marcó adicionalmente dos cosas que el humano no había visto (un log con PII y una race en la rotación).

En reviews de seguridad el modelo importa más que el editor. Claude Code apoyado en un Sonnet/Opus reciente da el mejor resultado de los tres.

Tarea 5: poblar un fichero de fixtures grande

420 entradas YAML respetando un esquema con 11 campos y validación contra una API real (cada entrada se hidrata desde una llamada). Tarea aburrida, mecánica, alta paciencia:

- Copilot: 8 minutos para las 50 primeras, después se vuelve repetitivo y el contexto no cabe.

- Cursor (mode Agent): 18 minutos para las 420. Sólido, con dos errores de validación menores.

- Claude Code: 14 minutos para las 420. Cero errores de validación. La diferencia es ridícula en tareas de productividad pura.

Resultados, tabla resumen y recomendación por escenario

| Tarea | Copilot | Cursor | Claude Code |

|---|---|---|---|

| Endpoint pequeño | ★★★ rápido | ★★★ | ★★★ |

| Refactor multi-fichero | ★ | ★★ | ★★★ ganador claro |

| Depuración con diff | ★ | ★★ | ★★★ |

| Revisión PR seguridad | ★ | ★★ | ★★★ |

| Fixtures grandes | ★ | ★★★ | ★★★ |

Recomendación práctica:

- Si el equipo es de plataforma o backend con muchas reviews y refactors: Claude Code como base + Cursor para sesiones interactivas.

- Si el equipo es frontend con mucho autocompletado puntual y poca review compleja: Copilot sigue saliendo más a cuenta.

- Si presupuesto es restrictivo: arrancar con Copilot y añadir Claude Code para los días en que toca refactor o auditoría.

Las herramientas que recomendaría en 2026 entran más en detalle sobre la pila completa de un equipo de plataforma. Para entender por qué el patrón skills + subagentes encaja con flujos como los de Claude Code, ver Skills y subagentes. Y la guía de MCP en 2026 explica cómo todos estos agentes están convergiendo en el mismo protocolo de herramientas.

El dato que cierra esta comparativa es de la investigación de JetBrains de abril 2026[1]: los desarrolladores experimentados usan 2,3 herramientas de IA distintas en promedio. La pregunta no es “cuál de los tres” — es cuál para qué.