Mixtral 8x22B: mixture of experts abierto y potente

Actualizado: 2026-05-03

Mistral AI liberó Mixtral 8x22B el 10 de abril de 2024 con el estilo que ya les caracteriza: un magnet link en Twitter sin blog post previo ni conferencias. La comunidad descargó los pesos en horas y al día siguiente ya había benchmarks. Es la generación siguiente de su arquitectura MoE (Mixture of Experts), con 141B parámetros totales pero solo 39B activos por forward pass. Esto cambia la economía de servir modelos abiertos.

Puntos clave

- La arquitectura MoE de Mixtral 8x22B activa solo 39B de sus 141B parámetros por token: capacidad de modelo grande con coste inferencial de modelo mediano.

- Apache 2.0 sin restricciones comerciales — la opción más permisiva a gran escala junto con Llama 3.

- Multilingüe superior a Llama 3 70B, especialmente en español, francés, italiano y alemán.

- El hardware mínimo es una A100 80GB o H100 80GB para servir cuantizado Q4; una GPU consumer de 24 GB no llega.

- Self-hosting compensa si procesas más de 100M tokens/mes sostenidamente; por debajo, los servicios hosted son más eficientes.

Qué es Mixtral 8x22B

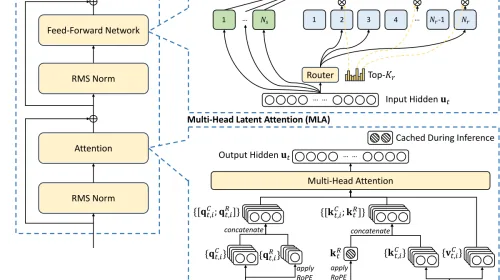

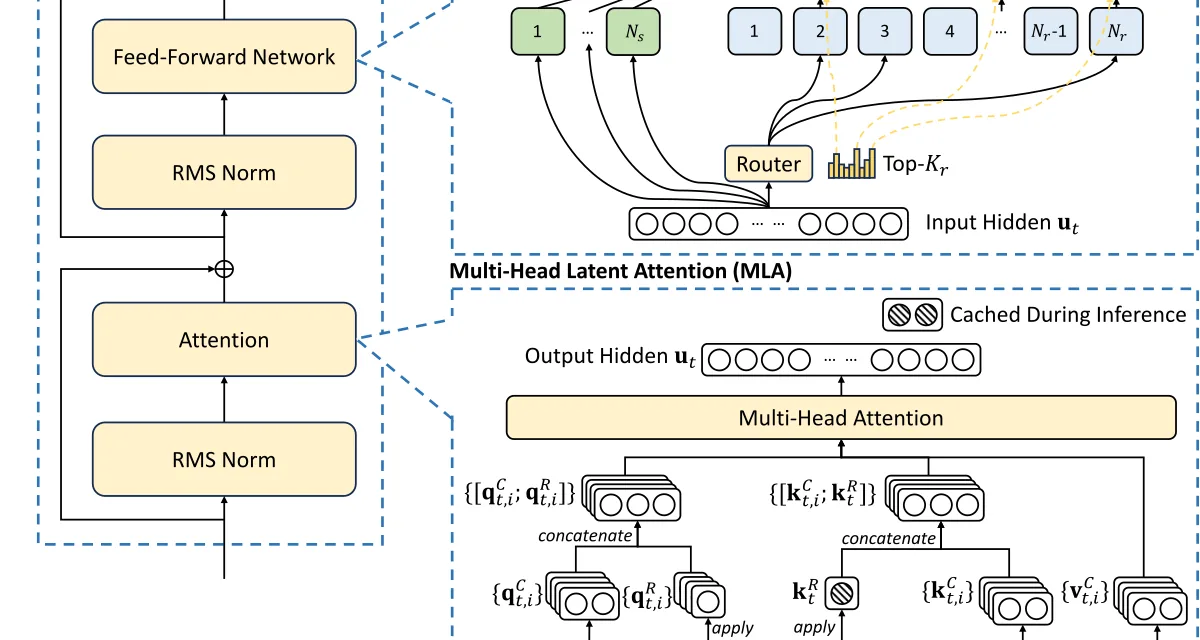

La arquitectura Sparse Mixture of Experts:

- 8 “expertos” de 22B parámetros cada uno.

- Router que elige 2 expertos por token.

- Total: 141B parámetros en disco.

- Activos por forward pass: ~39B (2 expertos + componentes compartidos).

El resultado: capacidad ~141B con coste inferencial ~39B. Mejor relación calidad/coste que un modelo denso equivalente.

Licencia y distribución

Apache 2.0. Sin restricciones de uso comercial. Los pesos están disponibles en Hugging Face (base[1] e instruct[2]) y los magnet links originales siguen funcionando.

Comparado con Llama 3 70B (licencia más restrictiva) o Claude 3 (cerrado), Mixtral 8x22B es la opción más permisiva a gran escala para uso comercial sin umbrales de usuarios.

Benchmarks clave

| Benchmark | Mixtral 8x22B | Llama 3 70B | GPT-4 | GPT-3.5 |

|---|---|---|---|---|

| MMLU | 77.8 | 79.5 | 86.4 | 70.0 |

| HellaSwag | 88.9 | 88.0 | 95.3 | 85.5 |

| GSM8K | 78.6 | 93.0 | 92.0 | 57.1 |

| HumanEval | 45.1 | 81.7 | 88.4 | 48.1 |

| Multilingüe (FR, ES, IT, DE) | Excelente | Bueno | Excelente | Medio |

Puntos clave:

- Calidad general cercana a Llama 3 70B con arquitectura más eficiente inferencialmente.

- Multilingüe superior — especialmente para casos de negocio en español, francés, italiano, alemán.

- Queda por detrás en matemáticas vs Llama 3 70B y en coding vs Claude 3 Opus.

- Para casos multilingües europeos, Mixtral 8x22B es probablemente la mejor opción abierta disponible.

Hardware requerido: el factor limitante

| Precisión | Memoria VRAM |

|---|---|

| FP16 | ~280 GB |

| INT8 | ~140 GB |

| INT4 (GGUF Q4_K_M) | ~80 GB |

| INT3 | ~60 GB |

Implicaciones prácticas:

- No cabe en una GPU consumer: una 4090 (24 GB) no llega ni cuantizada.

- Una A100 80GB o H100 80GB puede servir cuantizada Q4.

- 2× A100 40GB distribuido con tensor parallelism funciona.

- Apple Silicon M3 Max 128GB: cabe Q4 a ~5-10 tokens/s.

Para producción seria, casi siempre necesitas GPU de datacenter.

Comparación con Mixtral 8x7B

El hermano menor (46.7B total, 12.9B activos):

| Aspecto | 8x7B | 8x22B |

|---|---|---|

| Parámetros totales | 46.7B | 141B |

| Activos/token | 12.9B | 39B |

| VRAM Q4 | ~25 GB | ~80 GB |

| Calidad general | ~GPT-3.5 | Entre GPT-3.5 y GPT-4 |

| Multilingüe | Muy bueno | Excelente |

| Tokens/s (A100 Q4) | ~60 | ~25 |

Para muchos casos, 8x7B es más pragmático: más rápido, más barato, calidad suficiente. El 8x22B tiene sentido cuando la calidad importa más que el throughput. Ambos son buenas bases para cuantización con llama.cpp en despliegues edge.

Serving en producción

Con vLLM:

python -m vllm.entrypoints.openai.api_server

--model mistralai/Mixtral-8x22B-Instruct-v0.1

--tensor-parallel-size 2

--gpu-memory-utilization 0.9

--max-model-len 32768Con llama.cpp para Q4:

./server -m mixtral-8x22b-instruct-Q4_K_M.gguf

-c 16384 -ngl 99 --host 0.0.0.0 --port 8080vLLM ofrece mejor throughput en GPU. llama.cpp es más portable y maneja offload CPU-GPU mixto.

Coste de servir

- 1× A100 80GB on-prem: ~$15k/año amortizado.

- AWS p4d.24xlarge (8× A100 40GB): $32/hora = ~$23k/mes.

- Together.ai hosted: ~$2/1M tokens input + output.

Self-hosting compensa si procesas más de 100M tokens/mes sostenidamente. Por debajo, los servicios hosted como Together.ai, Anyscale o Mistral La Plateforme son más eficientes.

Casos de uso reales

Mixtral 8x22B brilla en:

- Multilingüe empresarial: documentos en ES/FR/IT/DE/EN.

- RAG con contexto largo (ventana de 32k tokens práctica).

- Summarización y análisis complejos.

- Self-hosting con compliance estricto: sin datos saliendo a la nube.

Otros modelos ganan en:

- Matemáticas: Llama 3 70B o Claude 3 Opus.

- Coding top-tier: Claude 3 Opus, DeepSeek Coder.

- Ultra-long context: Gemini 1.5.

Conclusión

Mixtral 8x22B confirma que Mistral AI lidera la frontera abierta en Europa. Su arquitectura MoE equilibra calidad y eficiencia inferencial de forma atractiva. Para equipos que pueden permitirse el hardware, es la mejor opción abierta para casos multilingües serios. Para quienes no, Mixtral 8x7B sigue siendo válido como opción más ligera. Y para producción seria sin GPU propia, los servicios hosted ofrecen acceso pay-per-token. El ecosistema abierto continúa cerrando la brecha con los frontier models cerrados — un complemento natural a la familia Claude 3 para organizaciones que quieren alternativa multilingüe de código abierto.