SLM en el edge industrial: cuando el modelo pequeño es mejor

Actualizado: 2026-05-03

Los modelos pequeños de lenguaje han dejado de ser curiosidades de laboratorio. Phi-3.5, Gemma 2, Llama 3.2 y los primeros Qwen 2.5 compactos han demostrado que un modelo de 2 a 8 miles de millones de parámetros, bien entrenado, resuelve tareas concretas con calidad suficiente para producción. Eso abre un espacio real en el edge industrial donde la latencia, la soberanía de datos y el coste de conectividad hacen que lo local compense.

Puntos clave

- Los SLM de 2024–2025 superan en tareas acotadas a modelos grandes de hace dos años gracias a mejores corpus de entrenamiento y ajuste de calidad.

- El edge industrial —plantas, almacenes, puntos de venta— tiene tres restricciones que favorecen lo local: conectividad limitada, latencia exigente y soberanía de datos.

- Las tareas donde los SLM ya funcionan en producción son extracción estructurada de texto, clasificación de incidencias, resúmenes de turno y chatbots internos con RAG limitado.

- El patrón de despliegue dominante en 2025 es híbrido: SLM en el borde para el 90 % de peticiones rutinarias, modelo grande en la nube como respaldo para los casos difíciles.

- Llama 3.2 y Gemma 2 rinden mejor que Phi-3.5 en español nativo; la inversión en evaluación propia vale más que cualquier benchmark público.

Qué ha cambiado para los modelos pequeños

Hasta 2023 el término SLM era casi peyorativo. Los modelos de 1 a 3 mil millones de parámetros eran juguetes comparados con GPT-3.5 o Llama 1. Dos cosas han cambiado la percepción.

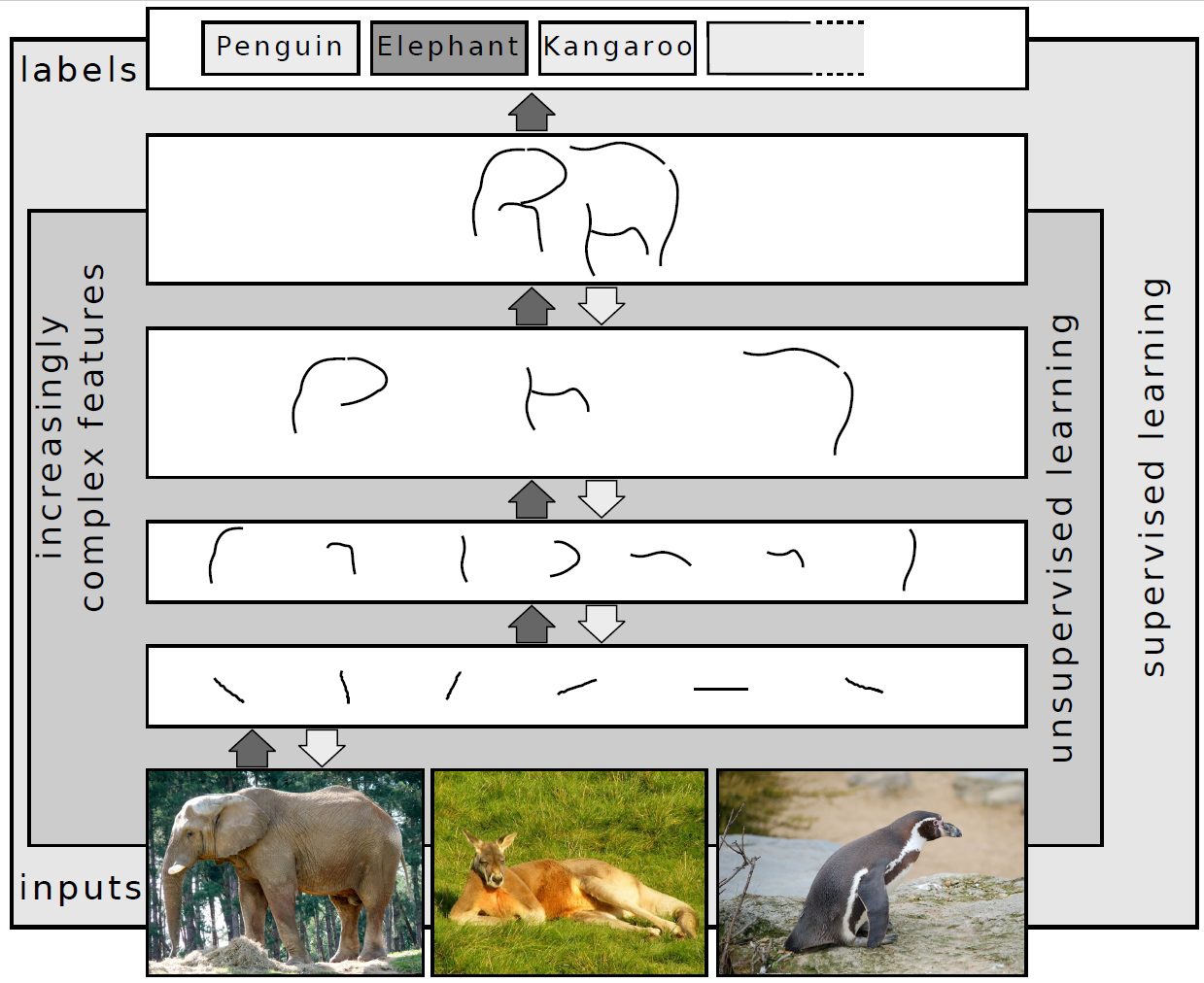

La primera es la calidad del corpus de entrenamiento: los modelos pequeños de 2024 y 2025 se entrenan con datos cuidadosamente filtrados, razonamiento sintético y refinamientos posteriores de alta calidad. Un modelo de 3,8 mil millones de parámetros como Phi-3.5-mini rinde en tareas de razonamiento de forma comparable a GPT-3.5 de hace dos años.

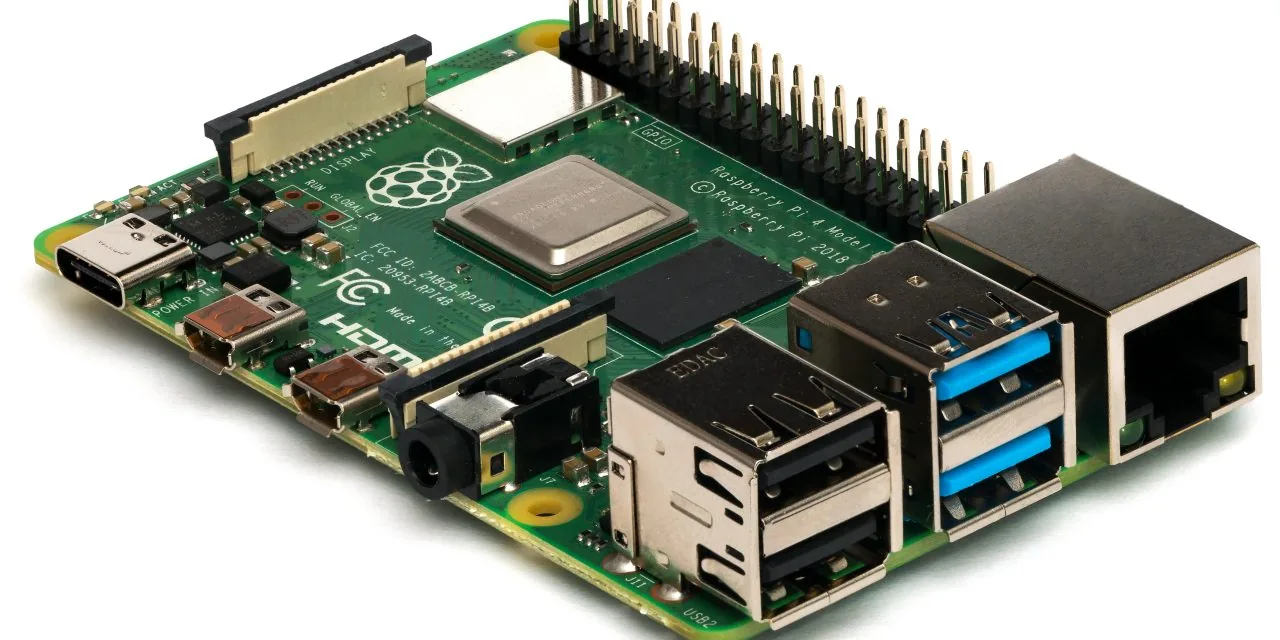

La segunda es la madurez del entorno de ejecución. Herramientas como llama.cpp, Ollama y vLLM han pulido la cuantización, la carga eficiente de pesos y el batching. Un modelo que antes requería una GPU de 24 GB ahora corre en una CPU decente con 16 GB de RAM con latencias aceptables.

El punto fundamental es que un modelo pequeño bien usado en una tarea acotada rinde mejor que un modelo grande mal dirigido en la misma tarea. Si lo que se necesita es clasificar texto, extraer campos o generar resúmenes cortos, un modelo pequeño ajustado o con buen prompt es suficiente. Llevar un modelo grande al edge para hacer lo mismo es, en la mayoría de casos, un desperdicio.

Por qué el edge industrial les pega

Las plantas, almacenes y puntos de venta tienen tres restricciones que el edge atiende mejor que la nube:

- Conectividad: no siempre hay enlace estable a internet, y cuando lo hay es caro o lento. Un modelo local elimina la dependencia de conectividad para las tareas que puede resolver.

- Latencia: para un proceso industrial que depende de una lectura para actuar, que la respuesta tarde dos segundos porque el paquete tuvo que cruzar el océano es un problema. Un modelo local responde en milisegundos.

- Soberanía de datos: muchas plantas tienen información sensible —diagramas, recetas, datos de clientes, cifras de producción— que no puede salir del perímetro por razones de cumplimiento con NIS2, GDPR o requisitos sectoriales.

En un entorno de oficina típica, donde hay buena conectividad y la soberanía no aprieta tanto, la balanza se inclina más fácilmente hacia la nube.

Tareas donde ya funcionan bien

Hay un conjunto de tareas donde los SLM en el edge ya funcionan con calidad de producción:

- Extracción estructurada de datos desde texto libre (facturas, albaranes, partes, OCR de etiquetas): un modelo pequeño con prompt bien diseñado extrae campos con tasas de acierto superiores al 95 % en la mayoría de documentos industriales.

- Clasificación y enrutado de texto: un operario escribe un parte, el modelo decide si es incidencia crítica, a qué equipo pertenece o si es duplicado.

- Generación de resúmenes cortos: un supervisor recibe decenas de lecturas de turno y el modelo las sintetiza en un resumen diario con los hallazgos importantes.

- Asistencia conversacional acotada tipo chatbot interno sobre procedimientos o manuales, con RAG sobre un corpus documental limitado. La calidad no es la de GPT-4, pero para consultas operativas estándar es más que suficiente.

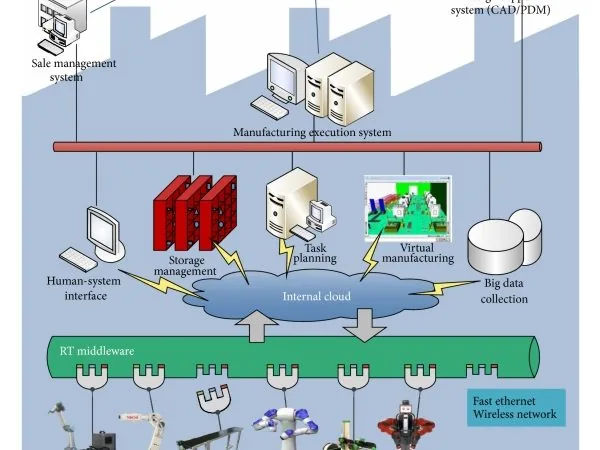

Para despliegues con GPU o NPU, este tipo de inferencia encaja bien con una arquitectura de contenedores ligeros que mantiene aislado el modelo del resto de la pila.

Dónde los SLM fallan todavía

Los SLM se quedan cortos en:

- Razonamiento de varios pasos sobre problemas complejos: calcular secuencias largas, depurar código complicado, analizar texto legal con matices.

- Conversación larga con mucho contexto: las ventanas son más pequeñas y la coherencia se degrada cuando el historial se alarga.

- Conocimiento amplio y actualizado: responder sobre actualidad, traducir jerga cultural o interpretar referencias recientes.

- Generación creativa libre: para material de marketing, texto literario o código original desde especificaciones abiertas, los modelos grandes siguen produciendo resultados claramente mejores.

El patrón de despliegue en 2025

El patrón que se ve funcionar en 2025 tiene tres capas:

- Hardware: un equipo con CPU potente o GPU modesta (RTX 4060 o equivalente) con 32 a 64 GB de RAM, entre 1.500 y 3.000 euros por nodo edge. Para tareas con baja latencia o alta concurrencia, una GPU integrada reciente de AMD o Intel basta.

- Ejecución: Ollama o un servidor basado en vLLM. Ollama es cómodo para empezar porque gestiona descargas, cuantización y sirve API compatible con OpenAI. vLLM escala mejor para alta concurrencia.

- Aplicación: el modelo se consume como API local con llamadas REST, igual que contra la nube. La diferencia es solo la URL, lo que simplifica la migración entre ambos lados.

# Descargar y lanzar modelo en Ollama

ollama pull phi3.5:3.8b-mini-instruct-q4_K_M

# Invocar con extracción de campo

curl http://localhost:11434/api/generate

-d '{"model":"phi3.5:3.8b-mini-instruct-q4_K_M","prompt":"Extrae número de lote"}'Para contextos de alta disponibilidad, la configuración de health checks de Ollama se puede integrar directamente con Traefik como proxy inverso.

Selección del modelo

- Phi-3.5-mini: rinde bien en razonamiento y tareas estructuradas; ideal para CPUs sin GPU.

- Gemma 2 (2B y 9B): buena calidad general con formato de instrucciones estable.

- Llama 3.2: destaca en tareas multilingües y tiene muy buen soporte en Ollama.

- Qwen 2.5: brilla en matiz de traducción y conocimiento amplio.

Para español nativo, Llama 3.2 y Gemma 2 suelen ganar a Phi-3.5 (optimizado para inglés). La diferencia entre modelos en la misma banda de tamaño es pequeña; la inversión en ingeniería de prompt y evaluación es lo que de verdad mueve la calidad. Conviene tener un conjunto de evaluación propio con cincuenta o cien ejemplos reales —ese conjunto vale más que cualquier benchmark público.

Mi criterio práctico

Si la tarea es acotada, de volumen alto y la latencia importa, el edge con SLM es la opción correcta. Si la tarea requiere razonamiento complejo, conocimiento del mundo amplio o el volumen es bajo, la nube con modelo grande sigue siendo mejor. La clave es no pensar en modelo grande contra modelo pequeño como dicotomía, sino como herramientas distintas con casos distintos.

La arquitectura que más se ve funcionar es híbrida: un SLM en el edge para el 90 % de peticiones rutinarias, y un respaldo a modelo grande en la nube para los casos difíciles que el modelo local marque como inciertos. Este patrón combina lo mejor de ambos mundos: coste bajo, latencia baja y soberanía para la mayoría, con un as en la manga para los casos raros.

El cambio cultural que falta es dejar de ver el modelo grande como respuesta por defecto. Para una gran fracción de casos industriales, un modelo pequeño local es mejor —más rápido, más barato, más privado y con menos dependencias. Aprender a distinguir qué casos caen en cada lado es una competencia que vale la pena desarrollar, sobre todo conforme los SLM sigan mejorando. La capacidad de integrar IA en entornos con conectividad limitada está redefiniendo la automatización industrial, de forma paralela a cómo los robots colaborativos están cambiando la línea de producción.